Nielegalne wykorzystanie wizerunku

Sztuczna inteligencja nadal zadziwia. Niestety nie zawsze jest to zdziwienie nacechowane pozytywnie. Możliwość tworzenia linii dialogowych bazujących na przesłanej próbce audio wiążą się z dużym ryzykiem.

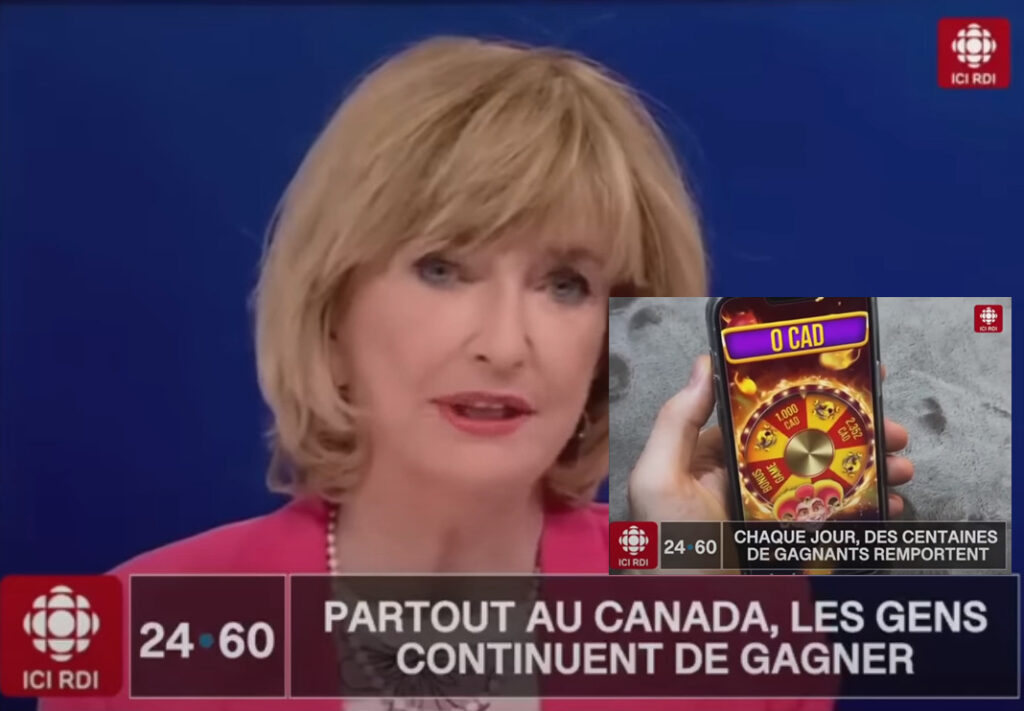

Analizowana reklama promowała aplikację do gier hazardowych i obiecywała pewne wygrane, kierując użytkowników na stronę nielegalnego kasyna. A wszystko przy wykorzystaniu wizerunku popularnej dziennikarki. Dussault wyraziła swój sprzeciw na Twitterze, twierdząc, że reklama ta “przywłaszczyła sobie jej tożsamość”. Poprosiła również internautów, aby zgłaszali jej każdy przypadek takiego napotkanego przez nich spotu.

Serwis informacyjny o nowościach technologicznych prowadzony przez Francois Charron opisał sprawę, zwracając uwagę, że choć początek reklamy jest oszukańczy i łatwo w nią uwierzyć, to w dalszej części deepfake staje się mniej wiarygodny. Rzeczywiście, głos Dussault zaczyna brzmieć tam mało realnie, a wręcz w sposób mechaniczny. Całkowicie wyzuto go z uczuć.

Dziennikarka ostrzega, że istotne jest zrozumienie tego sposobu działania, ponieważ niestety będziemy go widzieć coraz częściej. To samo internetowe kasyno nielegalnie wykorzystuje w reklamach na Instagramie głos i wizerunek Dussault oraz głos innego dziennikarza Radio-Canada, Sebastiena Boveta, który jest m.in. szefem biura Radio-Canada przy parlamencie prowincji Quebec.

Problem może się nasilać. Przybywa ofiar

Radio-Canada zwróciło uwagę, że od początku roku dostępne są tanie narzędzia wykorzystujące sztuczną inteligencję do tworzenia fałszywych wypowiedzi, które potrafią sklonować głos dowolnej osoby na podstawie tylko jednej minuty rzeczywistej wypowiedzi. Te narzędzia będą coraz bardziej doskonałe, a osoby bez doświadczenia w ocenie nagrań będą miały coraz mniejsze szanse na odróżnienie deepfake od prawdziwych wypowiedzi. Meta, spółka odpowiedzialna za Facebooka i Instagrama, nie odpowiedziała na pytania Radio-Canada związane z tym zagadnieniem.

Istota całego problemu polega na tym, że rzeczywiście niedzielni użytkownicy Internetu i wszystkich narzędzi, które on oferuje, mogą dać się nabrać. Można to po części porównać do metody „na wnuczka”, która dla wielu zapewne wydaje się absurdalna, a jednak niestety działa. Osoby rozpoznawalne często są angażowane do udziału w reklamach, by służyć za motywujący do wyboru produktu lub usługi autorytet. Tu dostajemy podobną sytuację, tyle że bez zgody tychże medialnych person.

Dodajmy do tego fakt, że bardzo niewielka liczba odbiorców ogląda dany materiał reklamowy w całości. Przykładowo, przy objerzeniu zaledwie 10 sekund z 40 sekund reklamy można nie zorientować się, że coś jest ewidentnie nie tak.

W ostatnich tygodniach pojawiły się również doniesienia o klonowaniu głosów kanadyjskich aktorów bez ich zgody. Telewizja CTV przytoczyła wypowiedź aktora Billa Newtona, którego głos został wykorzystany prawie 500 razy bez jego wiedzy.

Nagle mogę zostać rzecznikiem sprawy, której moralnie się sprzeciwiam – oznajmił Newton.

CTV również przytoczyła słowa profesora Patricka Parra Pennefathera z Uniwersytetu Kolumbii Brytyjskiej, który podkreślił znaczenie prawa do wizerunku i głosu oraz potrzebę istnienia odpowiednich rozwiązań prawnych. Nic więc dziwnego, że kwestię te poruszono w Unii Europejskiej, o czym pisałem TUTAJ.

Kolejne pozwy

Wobec firm odpowiedzialnych za sztuczną inteligencję wystosowano już pozwy, ale jedną z najświeższych spraw jest z związana z Sarą Silverman, amerykańską standuperką, satyryczką i aktorką.

Silverman oraz dwaj pisarze, Christopher Golden i Richard Kadrey, twierdzą, że chatbot ChatGPT opracowany przez OpenAI nielegalnie wykorzystuje ich twórczość. Zaznaczają, że nie wyrazili zgody na takie wykorzystanie ich prac.

Na prośbę użytkownika ChatGPT generuje streszczenia prac objętych prawami autorskimi. Według pozwu przeciwko OpenAI jest to możliwe tylko wtedy, gdy ChatGPT uczył się na tych właśnie materiałach. Nie trudno domyślić się zatem, że musiał uzyskać do nich w jakiś sposób dostęp.

Pozew wskazuje, że OpenAI skopiowało następujące książki: “The Bedwetter” autorstwa Sary Silverman, “Ararat” autorstwa Christophera Goldena i “Sandman Slim” autorstwa Richarda Kadreya. Pisarze uważają, że modele językowe OpenAI naruszają ich prawa autorskie i w pozwie przedstawiono przykładowe odpowiedzi ChatGPT na pytanie o podsumowanie wspomnianych książek.

Przypomnę tylko, że szef Midjourney, David Holz, sam oficjalnie przyznał, iż generatywne sieci neuronowe (GAN) muszą być trenowane na zbiorach danych. Wizerunek nas samych albo naszych bliskich może zatem zostać użyty właśnie w tym celu. Nie mamy zatem pewności, czy nasze wakacyjne fotki z Instagrama czy zdjęcia rodzinne z Facebooka nie zasilą zasobów, z których potem technologia Midjourney będzie mogła korzystać.

Pozew przeciwko firmie Meta dotyczy wykorzystania twórczości Silverman, Goldena i Kadreya w modelach językowych LLaMA. Według pozwów decyzje o tym, jakie informacje tekstowe wykorzystać w zbiorze danych treningowych są celowe i ważne.

Czytaj także: